En el mundo de la inteligencia artificial generativa, el prompting parece ser la única habilidad necesaria. Sin embargo, detrás de la magia de herramientas como ChatGPT se esconden riesgos de la IA generativa que, si se ignoran, pueden generar problemas serios para las empresas.

Por qué hablar de seguridad en IA ahora

En nuestro primer webinar de la serie “GenIA con Seguridad”, nuestro equipo en Hackmetrix, liderado por nuestro CTO Nicolás Mery y nuestra líder de compliance Jacquie Gutiérrez, exploró los riesgos de seguridad que enfrentan las empresas al adoptar la IA.

Del riesgo de la IA a la protección de la información

“La información en la actualidad es el activo más preciado, tanto de un individuo como de una organización”

Jacqui Gutiérrez, product compliance de Hackmetrix

La seguridad ya no es una opción, es una obligación. La IA llegó para quedarse, pero con ella vienen riesgos que no podemos ignorar. No se trata de detener la innovación, sino de dominarla y proteger lo más valioso que es la información.

Aprendizajes del webinar

¿Qué es la IA generativa y qué es un agente de IA?

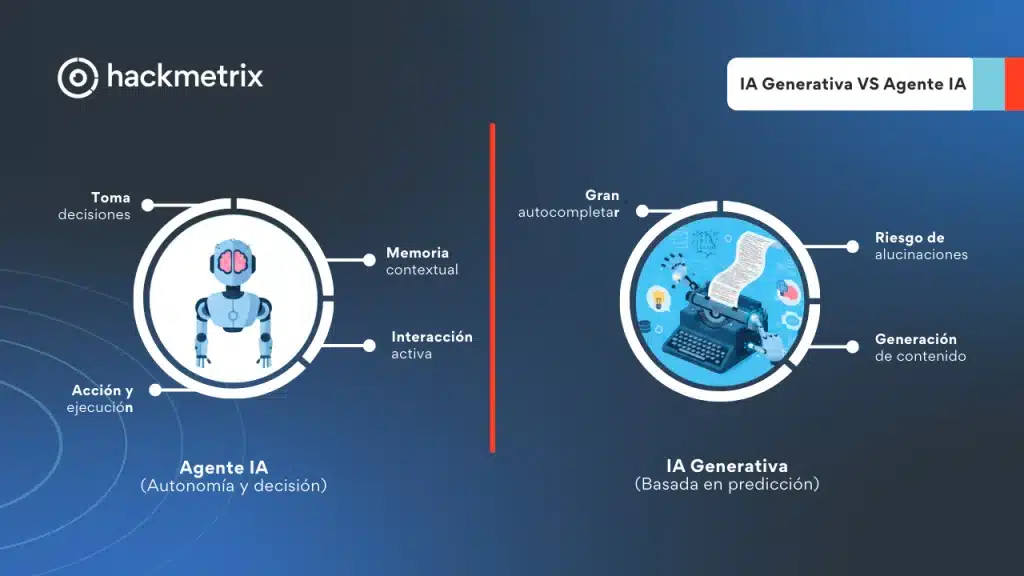

La IA generativa es como un “gran autocompletar”.

Utiliza modelos de aprendizaje profundo para analizar datos masivos y predecir el siguiente fragmento de texto o “token”, creando la ilusión de un diálogo. Un agente de IA, por otro lado, es una herramienta con autonomía para tomar decisiones y ejecutar acciones por sí mismo.

Por ejemplo, el agente de Hackmetrix, Mike, puede investigar empresas por su cuenta, mientras que una herramienta que solo chatea con un documento no es un agente, ya que no toma decisiones.

Riesgos ocultos de la IA que impactan a tu empresa

Pérdida de datos sensibles:

Información confidencial como código fuente o datos personales puede filtrarse si se introduce en herramientas de IA sin la seguridad adecuada. Un ejemplo notorio fue el caso de Samsung, donde un ingeniero subió por error código fuente interno a ChatGPT, lo que obligó a la empresa a prohibir el uso de estas herramientas.

Vulnerabilidades en Vibe Coding:

El Vibe Coding es una técnica donde una persona, sin ser programador, describe lo que quiere y la IA genera el código. Si bien acelera el desarrollo, el código puede ser inseguro, ya que no considera los requisitos de seguridad, lo que puede provocar vulnerabilidades, robo de credenciales o filtración de información.

Este fenómeno ocurre cuando los modelos de IA inventan información o dan respuestas falsas, lo que puede dar lugar a noticias falsas y desinformación en redes sociales, con graves implicaciones sociales.

Buenas prácticas para un uso seguro de la IA

A nivel personal:

- Verifica las fuentes: No confíes ciegamente en lo que la IA te dice. Siempre verifica la información que genera.

- Evita compartir datos sensibles: No subas documentos, fotos o información personal. Sé lo más ambiguo posible en tus preguntas.

- Usa la IA de manera responsable: No la uses para tomar decisiones importantes. Utilízala como un aliado, pero no como un sustituto del análisis crítico.

Checklist para uso personal

- Usarla para completar los análisis / información

- Verifica las fuentes

- Evitar compartir datos sensibles

- Reconocer la información falsa

A nivel de organización:

- Capacita al personal: Concientiza a tus empleados sobre los riesgos y el uso responsable de las herramientas de IA. El factor humano es el eslabón más débil de la seguridad.

- Documenta las políticas: Establece procedimientos claros sobre cómo usar estas herramientas dentro de la empresa y asegúrate de que todos los empleados las conozcan y las sigan.

- Implementa un proceso de seguridad: Si usas herramientas para generar código, establece un proceso de revisión y pruebas de seguridad antes de implementar cualquier código en producción.

Checklist para uso organizacional

Capacita al personal

Implementa un proceso de seguridad

Protege los datos del cliente

Documenta las políticas sobre cómo usar la IA dentro de la empresa

Ya dominaste los conceptos clave para un uso seguro de la IA. Ahora, es momento de llevar tu conocimiento al siguiente nivel. Suscríbete a Hacknews para acceder a noticias, tips y retos.

Glosario de términos clave en IA generativa

IA Generativa: Un tipo de IA que utiliza modelos de aprendizaje profundo para analizar datos masivos y predecir el siguiente fragmento de texto o “token”, creando la ilusión de un diálogo.

Token: Los fragmentos de palabras que la IA generativa utiliza para construir una respuesta.

Agente de IA: Una herramienta que tiene autonomía para tomar decisiones y ejecutar acciones por sí misma, sin supervisión constante.

Vibe Coding: Un estilo de desarrollo asistido por IA donde una persona, incluso sin ser programador, describe lo que quiere y la IA genera el código.

Alucinaciones: Cuando la IA inventa información o da respuestas falsas, lo que puede generar desinformación.

🎥 Serie GenIA con Seguridad: próximos episodios

2: Episodio 2: Hackeando tu IA (antes de que otros lo hagan)

3: Episodio 3: Gobierna tu IA con ISO 42001

Transcripción del webinar “Los riesgos que nadie te cuenta de la IA regenerativa”

Acá te dejamos la transcripción completa del webinar:

Bienvenida y contexto del webinar

Bienvenidos a la serie GenIA con seguridad de Hackmetrix y a nuestro primer webinar. Soy Natalia Molina del equipo de Hackmetrix, del equipo de marketing. Estoy muy feliz de estar de estar lanzando esta serie,que va a nutrir mucho a ustedes y a sus equipos.

Me gustaría que me cuenten desde dónde se conectan, desde dónde están aquí aprendiendo con nosotros. Yo estoy desde Cali, Colombia, y bueno, ya en el ya próximamente les voy a presentar a todo nuestro equipo.

No sé si todos aquí conocen ya Hackmetrix, entonces les voy a contar rápidamente qué hacemos.

Somos líderes en el sector. Somos una empresa de ciberseguridad. Hacemos la ciberseguridad más simple para las empresas de todos los sectores, medianas y pequeñas. Y con nosotros se pueden certificar hasta 10 veces más rápido en ISO 27001 en PCI y en ISO 27701 próximamente en SOC 2 y también en ISO 42001, que es la norma de IA.

Les voy a contar cómo rápidamente también cómo nace esta esta serie de GenIA. En una conversación con nuestro SEO, vemos que en este momento todo el mundo es prompt y ahí todo el mundo está hablando sobre la IA, pero no estamos hablando de seguridad. Por eso sacamos esta serie gratuita, donde en tres webinars seguidos vamos a hablar sobre los riesgos que nadie te cuenta.

Vamos a hacer una segunda sección un poco más técnica dirigida a CTO, dónde vamos se llama “Hackeando a tu IA”, donde vamos a contar todas estas vulnerabilidades que se deben de tener en cuenta. Y finalmente en el tercer webinar la vamos a llevar más dirigida a los ISOS, dónde vamos a hablar cómo gobernar la IA y que ella no nos gobierne a nosotros. Y sobre la ISO 42001, de pronto esto es más compliance.

Voy a presentar a nuestro equipo, al que va a estar hoy aquí con ustedes. ¡Hola Nico, ¿cómo estás?

Nicolás: Hola, ¿qué tal?, me presento, soy Nicolás Mery, CTO de Hackmetrix. Antiguamente fui CTO de Buda, que es un exchange de cripto, de Bitcoin catch, etc. también de una empresa de ciberseguridad. También fui responsable de la creación del de del área de ciberseguridad de Xepelin, una fintech.

Salí de la Pontificia Universidad Católica de Chile. Vivo en Chile también y soy actualmente estudiante del MIT, un programa para CTO. También debo decir que soy introvertido y bastante tímido, así que voy a hacer el esfuerzo aquí para que no se note tanto.

Natalia: Gracias por estar aquí, Nico, y bienvenido. Y acompañando a Nico, también está nuestra querida Jacqui. Hola, Jacqui, ¿cómo estás? Y danos el gusto de presentarte.

Jacqueline: Hola, Nati y Nico, ¿cómo están?, yo soy Jacqui Gutiérrez, soy ingeniera industrial, yo soy de Guadalajara, pero actualmente estamos aquí en Ciudad de México, justo acompañando a todo el team de Hackmetrix en México. Trabajé anteriormente en IBM, pero nada que ver con ciberseguridad.

Entonces, la vida me trajo aquí a Hackmetrix y es donde he aprendido todo, todo lo de compliance, ciberseguridad, tecnología y demás, porque prácticamente soy la líder del área de de compliance, trabajo con los especialistas en todas las normas que mencionaba Nati, con los auditores y esa parte que quizás de repente a los que son muy técnicos les puede parecer aburrida, pero es lo que hay que cumplir. Así es que es ahí donde entramos nosotros a apoyar.

Madurez de IA en la empresa: del interés a lo transformacional

Nicolás: Me gustaría hacer una introducción a este a este gráfico que me gusta mucho, es de maduración de una empresa en IA. Cuando se acerca a la IA, típicamente parte por el interés. Es como, hoy escuché que esto de chat GPT o esto de OpenIA ¿de qué se tratará?, cómo lo abordamos, tenemos que abordarlo y después ya empieza a madurar, a llegar a experimentar con probemos esto, probemos a hacer prompting, qué pasa si nos integramos con las API, ¿qué pasa si hacemos un robot, un chatbot? Después el siguiente paso es que sea operacional. ¿A qué se refiere? A que ya está metido en los procesos de la empresa.

Es decir, tengo procesos que están apoyados por IA. no es tan crítico en los procesos, pero sí usamos en los procesos embedido, es cuando ya es parte del funcionamiento de la empresa, es decir, hay procesos críticos que si es que no estuviesen andando sería un daño grande para la empresa. Eso ya es como que está embedido en la empresa la esa etapa de maduración. Y ya más allá es la que sea transformacional. ¿A qué se refiere esto? A que uno va madurando la IA ya con mejora continua y al mismo tiempo va transformando la empresa y la cultura de la empresa. Es como ya hay una sinergia completa con la con la IA y es parte de la empresa.

Nosotros en Hackmetrix estamos en BED más o menos entre operational, como ya tenemos procesos que son críticos con IA y de hecho tenemos un robot, un chatbot en Hackmetrix que usa IA y eso es ha tenido muy buena recepción de nuestros clientes.

IA generativa, tokens y capacidades

Nicolás: ¿Qué es la IA generativa? Es importante ese apellido. No es una IA normal, no es cualquier IA, es una IA generativa. ¿Y qué se refiere a que sea generativa? Aquí dice, “la IA generativa utiliza modelos de aprendizaje profundo como redes neuronales, para analizar grandes conjuntos de datos y entonces aprender sus patrones estadísticos”. Esto puede ser un poco árido de entender. Entonces, yo tengo otra definición más simple que me gusta, que es “la IA generativa es un gran autocomplete”, o sea, es como yo voy después de aprender una gran cantidad de datos, millones y millones de datos, por eso se le llama también aprendizaje profundo. una gran cantidad de datos, entonces soy capaz de predecir el contenido y el contenido que viene después de ese contenido.

Entonces, cuando ustedes ven chat GPT o ven otra herramienta que usa IA generativa, se van a dar cuenta que va apareciendo pedazos de palabras por pedazos de palabras. A esos pedazos de palabras se les llama tokens. Entonces aparece token por token. Lo que hace la IA generativa es poder predecir muy bien cuál es el siguiente token dado un input. Entonces, con el tiempo empezaron a salir habilidades emergentes, como que no ve hoy día alguna herramienta de este tipo y es como si estuviese hablando con alguien, pero en realidad no es así, sino que pareciera que sí, pero es porque captó una gran cantidad contenido, entonces sabe cómo responderte muy bien.

Agentes de IA vs. workflows: diferencias clave de seguridad

Nicolás: ¿Qué es y que no es un agente?, a veces hay confusión. Por ejemplo, el gráfico que se ve ahí abajo es un agente. ¿Por qué es un agente? porque tiene autonomía, toma decisiones, se adapta según lo que tiene que hacer, según el contexto y ejecuta acciones sin que se supervise constantemente, por ejemplo, Mike, es el agente de Hackmetrix y lo que hace Mike es que tú le puedes decir, “Anda a investigar una empresa.” ¿Por qué? Porque nos sirve saber al momento de calificar leads, calificar la posibles futuros clientes que tengamos, nos interesa saber de qué se trata la empresa, etc.

Entonces, eso lo hace independientemente. Tú le dices, “Anda a investigar” e investiga, se mete acá, encuentra tal dato aquí, después se mete en otra parte y eso lo decide el agente autónomamente. Entonces, eso es lo que hace un agente. Toma decisiones de manera autónoma. De acuerdo al input que le pasaste. Sin que alguien tenga que estar diciéndole lo que tiene que hacer.

Diferencia con Workflow

Nicolás: Hoy día hay varios ejemplos de workflow, por ejemplo, chatear con mi modelo para tener una conversación o chatear con mis documentos. Eso no es una agente. Algo que tú puedas chatear con un documento no necesariamente es un agente. ¿Qué decisión está tomando ahí? no está tomando ninguna decisión, solamente está tomando tus documentos, entendiéndolos y te está respondiendo en base a lo que tú le estás preguntando. Entonces, es importante esa diferenciación, que es un agente y que no.

Mike y PCR

Nicolás: Mike es un agente que nace porque tenemos un área que son de expertos, son los que se llama PCR internamente y son consultores y auditores de seguridad de la información. Como expertos es un talento costoso, ¿sí? Y además es difícil de obtener, porque por definición un experto es alguien que sabe mucho y es difícil conseguir unas personas que que saben mucho sobre un tema, son más especialistas en temas de performance, estos consultores internos PCR hacen algo así como 330 consultas o revisiones por mes. Esos son 15 al día, y cuatro auditorías internas al mes. El crecimiento de Hackmetrix es 100% anual. Ahora, ¿cómo lo hacemos para que podamos abarcar en la cantidad de demanda a medida que crece Hackmetrix a esta velocidad tan rápida? hay un déficit, no podemos, no se puede. Entonces nace Mike y ayuda en consultas. Entonces, los PCR gastaban tiempo y que no es raro cuando tienes un área de experto dentro de la empresa, gastan tiempo en consultas, consultas internas, consultas externas de los clientes, donde hay dudas y por ser los expertos ellos saben responder. ¿Qué solución se nos ocurrió? hacer un agente en Slack para uso interno y un chat para uso externo.

¿Por qué usamos Slack?

Nicolás: Es el lugar donde estamos continuamente funcionando. Y es importante que si alguna vez integran IA, sea el lugar de trabajo. ¿Por qué? Porque yo he podido ver que al hacerlo dentro del lugar de trabajo de la empresa, la cultura de inteligencia artificial de la empresa va madurando más rápido porque interactúa con Mike, por ejemplo, continuamente y eso hace que le pierdan el miedo a la inteligencia artificial y que empiecen a interactuar, empiezan a usar herramientas de IA.

Entonces es muy bueno y yo lo recomiendo harto que si integran un chatbot lo hagan en su ambiente de trabajo actual. Les va a ayudar la cultura. Entonces al final lo que hace Mike es aumentar la escala a bajo costo. Hoy día sale como $400 al mes con todo lo que está respondiendo y ayuda en un buen porcentaje al equipo PCR. Esto es más técnico y es la arquitectura de cómo funciona Mike.

Slack conectado con una nube que está en Amazon se conecta con estancia N8N y usamos AnythingLLM para la base de datos, se podría decir, y usamos un proxy para conectarnos con distintos modelos de lenguaje grande.

Seguridad y privacidad con Mike

Nicolás: Es importante el tema de la seguridad. Nosotros cuando hicimos Mike lo hicimos pensando en la confidencialidad, la integridad y la disponibilidad de las data. Es muy importante que la actividad se mantenga. Por eso mismo nosotros usamos una estrategia donde no estamos entrenando nuestros modelos con data de los clientes, sino que usamos data, se podría decir que en tiempo de ejecución. Se enriquece en el contexto del modelo, del agente y después con eso puede responder.

No estamos haciendo que en el modelo quede guardada información de los clientes. Eso fue una decisión consciente de que no queremos hacer eso por seguridad. Y además que no se puede hacer eso sin permiso del cliente. Yo creo que el impacto de hoy día el 95% de las preguntas que se le hacen a PCR responde Mike exitosamente, que es muy bueno. Tuvimos muy buen éxito en lo que es el uso de Mike.

Natalia: Aprovechó para mencionar, ya que estás diciendo eso, que cuando mostraste el primer agente, cuando estabas mencionando que es un agente y que no, Adolfo nos mencionaba que a ese agente le faltaba una memoria para que tenga contexto de la conversación y responda de la forma más coherente.

Nicolás: Tiene toda la razón. Al agente le faltaba la memoria. Lo que pasa es que a ese agente le llega la memoria por el input. Es un agente especial. Porque la memoria, como es esa que mostré es una gente que usa Slack, la memoria del chat viene en el.

Natalia: No, se mencionaba el que mostraste N8N.

Nicolás: Sí, la memoria está dentro de N8N, pero sí tiene toda la razón. Es importante la memoria para que tenga un contexto de la conversación que ha tenido, sino va a ser como que siempre parte la conversación de cero.

¿Cómo interactuar con Mike (nuestra IA)?

Nicolás: Voy a mostrar cómo interactuar con Mike. No puede hablar con Mike diciéndole, “Hola, Mike.” Es como un agente normal y uno le puede decir, Mike, qué sabe quién soy porque se le cargó en el contexto y también la personalidad de Mike está definida también dentro de la gente en un system prompt para los que saben. Entonces podemos ir y preguntarle, Mike, ¿por qué para una empresa podría ser importante tener la certificación? ISO 27001.

Entonces, lo que hace ahí Mike es que el mensaje pasa de Slack, Slack pasa a se acuerdan a la máquina que corre estos estos agentes que está que se llama N8N. Es una herramienta open source. Nosotros usamos bastante open source. De hecho, en el diagrama que les mostraba antes está N8N, está en LLM, está Light LLM, son todos open source. No es importante usar open source.

Natalia: Aprovecho y te hago esta pregunta que alguien está haciendo y yo sé que muchos de pronto lo tienen. Entonces, Adolfo dice lo siguiente. Consulta. Mike tiene acceso a nuestros documentos que estamos trabajando en la plataforma de Hackmetrix para poder preguntarle sobre algún documento en particular y que nos orienten cómo completarlo o que nos guíe en qué nos falta para llegar al cumplimiento o qué norma cumplimos.

Nicolás: Se podría decir que tenemos dos mike. Hay un mike que es interno, que es este que está en Slack y está el mike que ustedes ven en la plataforma de Hackmetrix. El mike que está en la plataforma de Hackmetrix sí tiene acceso a sus documentos y puede ir y orientarlos en lo que necesite. Este mike no, porque no podemos llegar y compartir sus documentos, obviamente con cualquier persona dentro de Mike. Entonces, mostremos la respuesta que nos dio Mike y continuamos. También otra cosa que hace Mike es que puede investigar empresas. Entonces, puedo decirle investiga, qué sé yo, qué empresa podría ser.

Vibe Coding: velocidad vs. seguridad en desarrollo asistido por IA

Nicolás: El término fue acuñado por Andrés Carpati en febrero de 2025. Ojo, no ha pasado ni un año, pero se ha vuelto bastante popular porque y tenemos una teoría que es porque te deja crear de manera rápida y relativamente fácil cosas con software. Y tú puedes ver el software, algo que antiguamente era difícil de ver en ese tipo de desarrollo rápido. Hoy día se puede hacer muy rápido con Vibe Coding, y la idea de Andrés es que uno va y deja de programar para seguir como los vibes, como la onda, como ir y ser más intuitivo al momento de programar. Ya.

Entonces, vibe coding es algo que casi cualquier persona puede hacer, necesitas saber escribir bien prompt a un a una herramienta y la herramienta lo hace. Entonces, ¿qué es vibe coding? Es un estilo de desarrollo, ¿sí? dónde asistido con inteligencia artificial, un programador o alguien incluso que no sea programador puede describir lo que quiere con lenguaje natural escribiéndolo, incluso con fotos que también agrega con texto para que un modelo genere el código.

Entonces, el rol humano pasa a describir líneas precisas que para programar es casi matemático donde tú tienes funciones y vas escribiendo las variables, qué sé yo. Y tiene que ser muy preciso porque si te equivocas el programa no corre. Entonces pasas de eso a algo que tú puedes ir a hablar con el modelo.

Demo con Cline en VS Code: pros, contras y alternativas

Nicolás: Aquí está es una herramienta que se llama, o sea, un editor que se llama Visual Studio. Es bien popular para los programadores. Y tengo instalada una extensión de Visual Studio que se llama cline. Y a cline tú le puedes decir cosas como hola cline, quiero que programes algo que puede ser, por ejemplo, un buscaminas, un juego de caminos, por decir algo, le digo yo. Y esto lo que hace por debajo es enviarlo a un modelo, que lo hoy día lo tengo configurado con un modelo de cloud, y te dice, “Okay, vamos a hacer un te responde en el mismo lenguaje qué le pregunté, y qué y te dice lo que va a hacer, ¿okay? ¿Tú puedes leerlo o no?” Y acá me está preguntando cómo quiero el tablero y le digo tablero clásico. Entonces, perfecto, este es el plan y te dice, este es el plan.

Okay, esta es una herramienta que igual es más compleja tal vez que el vibe coding típico. Hoy en día puedes usar herramientas que son muy fáciles de usar, ¿no? No casi nunca des el código por dejar a no ser que quieras. Entonces digo, “entonces vámonos a ACT.” Y cuando pasó a Act dejé de estar el modo planificación y dice, “Okay, pongámonos mano a la obra. Y esto es lo que voy a hacer al comienzo. Y empiezo a ejecutar cosas. Y aquí está creando la carpeta. Y aquí ya empiezo a programar.

Natalia: Justo la estaba guardando para este momento mientras primero si me letras cómo se llama la herramienta para ponerla aquí por un lado.

Nicolás: Cline.

Natalia: Cline se llama la herramienta. Ahí lo pongo en los comentarios para que lo tengan en cuenta. Y entonces aquí va la pregunta que nos hace Nicolás Cartagena y él habla sobre Mike. Esta pregunta le hice cuando estabas hablando de Mike y él dice, Consulta, la búsqueda también lo hace a través de redes sociales como LinkedIn, la búsqueda que estabas mencionando que hace Mike la investigación.

Nicolás: La verdad no lo sé. Él tiene acceso a internet y tiene acceso a Google. De hecho, ni siquiera Google creo que usamos el Brave Search. Entonces como que empieza a navegar internet y tal y probablemente de acceder a LinkedIn o alguna red social porque creo que puede acceder también a Instagram.

Ahora que Instagram está público y está indexado, también podría acceder a Instagram. Sí, si es que tiene acceso por Google, por algún buscador, sí de poder tener acceso. Ahora, probablemente el tipo de acceso, o sea, seguramente el tipo de acceso es público, ¿sí? no está logueado con ningún usuario, entonces es limitado lo que puede ver.

Natalia: Y también nos dice Adolfo que sí, que él está viéndolo el vibe coding, pero pues aún no termina de convencerlo.

Nicolás: Sí, vibe coding tiene un grave problema. El problema grave de vibe coding es que es demasiado fácil, entonces y mágico y uno puede trata pensar que lo que hace el programa está está bien y es seguro, pero no es necesariamente seguro porque fue hecho de acuerdo a las reglas que tú le dijiste, que tú le que tú le mencionaste aquí en el prompt. el primer que le envié que quiero un buscaminas. Eso es la información que tiene. No, nunca le dije que quería un buscamina seguro.

Entonces ya han habido casos donde, por ejemplo, alguien haciendo apunta de vibe coding en un sitio web y lo levantó muy orgulloso y todo, pero tiene varias fallas de seguridad, entonces no y se las encuentran y le botan el sitio y qué sé yo. Entonces hay que tener cuidado. Esto de vibe coding no necesariamente tampoco tiene que ser inseguro. Ojo, uno si revisa el código, si tiene buenos controles de seguridad, el resultado puede ser muy bueno.

Natalia: Y antes de la siguiente pregunta, hago un spoiler y es que el siguiente webinar, bueno, ya les había mencionado, pero puede ser que todos no escucharon, eso es una serie de tres webinars. Este es el primer webinar y el segundo webinar es un poco más técnico, o sea, que usted para el siguiente webinar tráigase al CTO, tráigase al CTO, tráigase a los deps de su equipo y ahí vamos a hablar sobre las vulnerabilidades.

Vamos a presentar algunas, las vamos a explicar más a detalle. Aquí en los comentarios les voy a dejar el link para que se puedan inscribir a ese próximo webinar. También en la descripción del video lo pueden ver en el número dos. Listo. Entonces, aquí les pongo el link también en los comentarios. Y entonces aquí viene la siguiente pregunta y es que Martín nos dice, cline es como cursor.

Nicolás: Sí, pero cline es gratis. y Cursor tiene, ¿cómo se llama?, una política de que el código lo analiza y lo analiza en sus servidores. Bueno, depende del plan en que estés. En el plan pagado creo que hay un plan que tú puedes decir, “No quiero eso”, pero hay un plan que sí lo hace.

Entonces, nosotros por seguridad no lo preferimos, pero podríamos haberlo usado si es que hubiésemos pagado más. Sí, pero encontramos esta solución que es open source, está de nuevo cline, y nos gustó y funciona bastante.

Natalia: Y dejó el último comentario que Adolfo nuevamente nos dice cuando estabas mencionando lo de los riesgos, que justo por eso es que no le convence. José David nos dice también, nos hace otra pregunta. Entonces, con cline, ¿Uno se puede apoyar la creación vidas de algún tipo de programa?

Nicolás: Efectivamente, por ejemplo, ahora hicimos el buscaminas y ya terminó y yo no he programado nada, lo programó cline, ya hizo todos los archivos en Java Script, incluso es un Readme. El Readme es el típico archivo que tienen los repositorios que indican cómo funciona el repositorio. También lo hice. Entonces yo voy acá, digo, “Okay, córreme eso.” Y se va al buscaminas. Y ojalá que sí, parece que funcionó. Yo soy pésimo buscaminas. Puedes apuntar eso en tu introducción.

Ya. Bueno, pero funciona. Sí, esa es la idea y lo hizo de una. Eso es impresionante. Solamente ingresé, quiero un buscaminas y lo hizo. Ahora, ojo, esto es algo un ejemplo de juguete, hacer un programa más complejo involucra más prompting. O sea, aquí yo puedo ir y decir no lo voy a hacer porque nos demoraríamos mucho, pero puedo decirle, oye, cámbiame el estilo a que sea algo más cyber o más al estilo hackmetrix o qué sé yo. Y eso lo va a hacer, va a hacer los cambios y podemos iterar de pronto. Lo importante es que de acuerdo a lo que vayan a hacer tengan más cuidado o menos cuidado con la con la calidad que están haciendo.

¿Cómo hacemos vibe coding en Hackmetrix?

Nicolás: Nosotros vemos que hacemos vibe coding de dos maneras internamente. Hacemos vibe coding así como mostré ahora, sin mucha preocupación para hacer POC y para hacer pruebas de concept, o sea, de concept, una POC, hacer MVPs, pero MVPs muy básicos, ¿sí? para y eso te ayuda a aprender más rápido y acelerar tu flujo de desarrollo o de conocimiento de lo que estás haciendo, mejor dicho.

Pero ya llega un punto donde ya sabemos lo que queremos hacer y ahí hacemos el cambio a algo que le llamamos Vibe Engineering. y Vibe Engineering es tener mucho cuidado con la calidad que hace el agente, o sea, hacerle code review, igual que fuese cualquier code review, hacer revisiones cruzadas, qué yo, como testing, que se incluso tenemos un agente que revisa el código, también lo usamos y te te mide la deuda técnica interna de los PR.

Riesgos ocultos de la IA

Jacquie: Bueno, entonces yo les voy a contar un poquito sobre los riesgos que nadie nos cuenta sobre IA. Y ahora dándonos cuenta de todos estos temas, puede ser que más bien decidimos ignorarlos, ¿no? Por ahí Adolfo ya me gustó mucho su punto porque veo que hay gente entonces que sí está tratando de tomarlo con calma, pero igual es importante que lo entendamos. Entonces, bien, podemos preguntarnos tal cual qué podría salir mal con el uso de la no.

Aquí vamos a ver un meme que puede ser un gran chiste o una muy mala anécdota dentro de tu empresa o en dado caso hasta pues nos puede pasar a nivel personal, ¿no? Entonces aquí es importante entender justamente la parte responsable, no sé si se han preguntado justo eso, ¿no? ¿A dónde va a parar toda esa información que le preguntan a la inteligencia artificial? o justo si han utilizado chat GPT o alguna herramienta similar, ya sea para consultarle cosas de su trabajo, que es quizás lo más común en el foro que de la gente que tenemos aquí, pero seguramente también en de manera personal conocen a alguien o ustedes son los que ponen que qué enfermedad tengo y con qué me curo, ¿no?

Entonces, es ahí donde es muy importante como que ir definiendo una una línea porque no sé si se lo han preguntado o lo han visto incluso, pues qué va a pasar si una persona malintencionada puede extraer desde datos personales, propiedad intelectual, información confidencial que quizás pues por andar preguntándole cosas a ChatGPT o incluso en temas de desarrollo, ¿no? Como bien lo explicaba también Nico, puede haber ahí un gran tema de riesgos. Entonces, la respuesta es corta, ¿qué podría a qué podría salir mal?

Hay muchas cosas. Puede haber multas en temas hasta regulatorios y demás. Y pues un impacto muy grave a la empresa, si es que es el caso, en temas de reputación o o pues sí, ahora sí que de la imagen. ¿Vale? Entonces, bueno, les vamos a contar sobre tres casos que vamos a ir identificando ahí un poquito los riesgos, ¿no? También por ahí vayan haciendo su análisis. Entonces, bien, haciendo la conexión con lo que comentaba Nico.

Una herramienta, muchos riesgos

Jacquie: Vamos a hablar justo del vibe coding rapidísimo, ¿no? El que no es para producción. Por ahí ya tomando esa descripción que nos contaba Nico de que es como está manera rápida, mágica de generar código, es importante eso, o sea, no confiar ciegamente en el Vibe Coding, o sea, es revisar, es entender, es robustecer quizás tu proceso de código, pero con estas herramientas, pero también el tema de revisión, de calidad, de de identificar vulnerabilidades y demás.

Entonces, no lo recomendamos tanto para producción o al menos teniendo muy claro el tema de los riesgos que esto puede derivar. Y justamente en este artículo que que les mostrábamos ahí, una pequeña imagen, nos da la siguiente cifra, que es que para el 2028 se prevé un estudio por ahí que nos compartieron en el artículo, se prevé que el 90% de los ingenieros de software o los desarrolladores pues van a utilizar estos asistentes de código, ¿no? Entonces aquí pues tenemos de dosas, como decimos en México, tenemos justo la parte buena. Vamos a agilizar muchísimo los procesos, va a ser de 3 días a 2 horas el codificar algo, etcétera.

Pero la parte negativa también viene en que si justo no tomamos las medidas necesarias, se puede por ahí generar una brecha de seguridad muy importante, ¿vale? Entonces, bueno, pueden decir, “Qué interesante información, qué buenos datos y eso qué, ¿no? ¿Cuál es el riesgo entonces aquí?” O sea, bueno, básicamente muchos. ¿Por qué? Porque justo con ese vibe coding, como lo mostraba Nico en la demo o demás, pueden pasar muchas cosas.

Si no realizas una buena revisión de de tu código, si no utilizas herramientas para estarlo analizando, para detectar errores y demás, te puede ocurrir filtrado de información, te puede ocurrir incrementar los errores en tu software y derivado de eso que tengas fallas en el sistema, que se te caiga el sistema, que pues por ahí obviamente se inyecten cosas no confiables, ¿no? que un atacante luego pueda entrar a la base de datos de la propia herramienta de inteligencia artificial. Pueden pasar cosas muy malas.

Casos reales de riesgo en IA generativa

Jacquie: Por ahí Nico justo me contaba un caso, es un poquito más técnico, pero me comentaba eso, ¿no? Un riesgo del vio code también puede ser como de que tus API keys con las que se autentica una solicitud o el requerimiento entre aplicaciones y demás no autorizada, pues puede que se autorice si es que dejas las keys en el front, ¿no? Entonces también eso es parte del vibe coding de que no se revise correctamente. Entonces, esto se filtra y ya ahí te van a estar haciendo 1000 cosas en en tu sistema o en tu software.

Caso Samsung: filtración de código y políticas de uso de IA

Jacquie: Este fue muy sonado, entonces quizá por ahí ya lo ya lo habían escuchado o lo o lo llegaron a ver, que fue el caso de Samsung. ¿Qué pasó con Samsung? básicamente se les el riesgo pesadillas se les hizo realidad, qué fue de que se les hizo una filtración de información sensible porque uno de sus ingenieros por error subió a Chat GPT código de código fuente interno y se dieron cuenta alrededor de un mes después pues que fue filtrado en esta herramienta y pues tuvieron ahí que tomar las medidas necesarias, ¿no? Pero esto derivó que Samsung prohibiera, o sea, en sus políticas prohibió el uso de las herramientas de inteligencia artificial generativa.

Ahora sí que más tarde que más pronto que tarde para evitar cualquier otra cuestión. Entonces, bueno, aquí para comprender también un poquito mejor el por qué quizás estas empresas deciden mejor prohibir las herramientas o este tipo de filtraciones son importantes porque también puedes pensar como, bueno, quizás no se filtró información muy importante, ¿no? Sigo utilizando la herramienta o sigo sin verificar las fuentes o dependiendo para lo que la utilicen.

Pero también hay que recordar algo muy importante, o sea, la información que tú compartes a la inteligencia, ya sea justo en chatbots, en agentes o con esto de vibe coding y demás, también puede ser almacenada en los servidores que son propia de las empresas que que dan este servicio, ¿no? Como puede ser Open AI, como puede ser Microsoft, Google, etc. Y toda esta información puede funcionar para su entrenamiento. entiendo que puede estar ya un poquito más regulado el tema porque al inicio como que cuando salió obviamente los los las herramientas y chat GPT y demás bom boom y como que todos estábamos ahí probando.

Pero sí es importante eso, cómo tenemos la seguridad de que nuestra información o lo que sea que le estemos preguntando, lo que sea el contexto, los prompts, no están siendo usados para otras respuestas. Entonces ahí también es eso, no hay una manera sencilla de acceder a esa información para borrarla o no hay una manera de quizás decir, “Oye, Microsoft, ¿puedes borrar, por favor, mi información?” Entonces es es ser cuidadoso con esa parte.

Las herramientas de IA más propensas a filtraciones de datos

Jacquie: Justamente en este artículo también, derivado de eso, les comparto unas pequeñas un dato rápido. Las herramientas con la mayor cantidad de violaciones en las políticas justo de prevención de pérdida de datos son estas: Chat GPT, Wordon, Microsoft, Claude, Grammarly y DeepL. Entonces, son las que más han tenido como que estos casos de que tienen estas filtraciones, ¿no? Que no cubre, no cumple con las políticas internas de la organización sobre prevención de pérdida de datos.

Y un dato interesante también es eso, que entre las filtraciones la información que más ha aparecido y que más se ha como que pues divulgado es el tema de los números de seguridad social, contenido para adultos y justamente código fuente. Entonces, por ello seguimos reforzando el tema de que el vibe coding puede ser muy bueno para pues sí, para testing, para probar ideas, como comentaban también ahí por el chat, más no utilizarlo como que totalmente ya me generó esto, lo despliego en en un entorno productivo.

Vulnerabilidad de los asistentes de código

Jacquie: Les cuento el tercer caso, que es un artículo donde nos cuenta sobre una vulnerabilidad que se identificó en este asistente de dúo que se llama dúo de Gitlab, que por ahí seguramente saben que Gitlab pues es esta plataforma de desarrollo colaborativo, ¿no? Entonces esta vulnerabilidad para no darles tampoco un discurso muy técnico y no salirme no confundir, esta vulnerabilidad a nivel de riesgos pudo haber ocasionado muchas cosas.

Al estar utilizando la herramienta pudo haber hecho que con el código esté ayudado con este asistente pueda dirigir a las víctimas a sitios web maliciosos donde quizás te ponen una landing page, una página de inicio de sesión, tú confías en eso, pones tus carenciales y ya las filtrante, ya las compartiste, ¿no? también puede ser que te puedan robar el código fuente de tus proyectos que pues son privados, ¿no? o son confidenciales por estar utilizando este asistente va a tomar todo lo que tú estés ingresando y estaba esta vulnerabilidad de que un atacante pues podía acceder a eso y robarte tu código fuente.

También tenemos el caso de la manipulación de las sugerencias. Por ejemplo, justamente si con este asistente pues te está mostrando cómo codificar, te está mostrando recomendaciones y sugerencias, pues también puede ser que te esté trayendo lo de otros usuarios. Entonces también ya sea que tú seas el afectado o estés utilizando el de otra persona, está generando eso ese riesgo, esta vulnerabilidad.

También esto podía generar el extraer vulnerabilidades de día cero que quizás aún no estén reveladas y los riesgos que ya hemos conversado un poquito, ¿no? filtración de información, robo de credenciales, por ahí la inyección de de cosas no confiables, de bronze, de estas cosas un poquito más técnicas que por ahí Nico me puede ayudar más, pero que este los desarrolladores seguro lidian con eso en el día a día para asegurar que lo que están haciendo es seguro.

Natalia: Voy a hacer un comentario que nos está dejando Adolfo, es que dice que además de la pérdida de datos personales o corporativos, también están las alucinaciones, que cuando no sabe qué responder, inventa lo que le parece que nos gustaría leer.

Y aprovecho y hago mi comentario ahí. No sé si han visto los nuevos memes como en que cuando uno sabe algo se da cuenta que ChatGPT no sabe. Cuando tú sí sabes ese tema te das cuenta que ChatGPT no sabe sobre ese tema.

Jacquie: No, y muy buena observación porque mira, Adolfo viene con todo porque justamente era el siguiente riesgo del que les quería contar un poquito. Ahí a lo que estuve investigando, leyendo y demás, este riesgo o esta situación que sucede de la alucinación de de que te dicen cualquier cosa también pasa mucho por el modelo o disculpen por ahí creo que fue aburrido.

Pasa mucho por el entrenamiento y la manera en la que están justamente entrenados, se me fue la palabra, como configurados, este, programados, etcétera, porque justo prefieren darte un texto grande en lugar de parecer como una respuesta corta y que no saben la respuesta. O sea, como que su configuración por defecto es, yo te voy a dar el así la respuesta gigante para que pienses que esto está bien.

Las alucinaciones de la IA y su impacto social

Jacquie: Entonces, bueno, volviendo un pasito atrás, así rápidamente les cuento que justo la alucinación en términos pues dentro del mundo de la IA es la generación de información e incluso ya ven que también ya hay imágenes, vídeos, etcétera, que pueden ser falsos o engañosos.

No es como bien comentaba Adolfo de que la IA se inventa cosas en lugar de simplemente darte una respuesta basada o en sus datos de entrenamiento o en fuentes validadas. Entonces esto genera un riesgo súper importante y creo que esto ya no solamente aplica a organizaciones, aplica a la sociedad.

¿Por qué? porque pues no sé si se han puesto a pensar justamente en las famosas fake news o que si vieron justamente un TikTok, un WhatsApp, cualquier cosa en las redes sociales, hasta de noticias que pueden hasta parecer muy amarillistas o cosas así, ya no sabemos de dónde viene, o sea, ya no tenemos tan a la mano el de dónde salen esas cosas, los videos.

Yo me he sorprendido de la cantidad de fotos y videos que son que parecen muy reales y no lo son. Entonces, hay que recordar que la información en la actualidad es el activo más preciado tanto de un individuo como de una organización. Entonces, como bien decía el sabio tío Ben de Spider-Man, un gran poder conlleva una gran responsabilidad.

Entonces, quien controle la información, si no tiene buenas intenciones, pues podría ser algo derivar en algo no tan bueno. Pero bueno, ya después de que les dimos todos los peligros y quizás ya los preocupamos un poquito y están ahí cancelando sus suscripciones a todas las herramientas, no todo es preocupación.

Mejores prácticas de seguridad

Jacquie: Buenas prácticas que pueden implementar muy sencillas, o sea, como pueden ver, son muy sencillas para que obviamente podamos ir implementando esas barreras y esas medidas de seguridad, ¿no? Proteger nuestros datos, nuestra información, etcétera. Entonces, a nivel personal, pues antes que nada siempre verifiquen las fuentes.

No confíen ciegamente, que es nuestro punto tres, no confíen ciegamente en lo que les dice la inteligencia artificial y por favor no la usen en decisiones importantes, ¿no? como de que, oye, si firmo este contrato para comprarme, o sea, hay que analizarlo igual, no lo hagan su mejor amigo, pero obviamente puede ser un gran aliado para ciertas cosas, pero justo hay que verificar bien las fuentes.

Y bueno, el puntito del medio que que me brinqué, pues no usen datos personales, no suban fotografías de de sus documentos, no suban ahí, no sé si quieren dar contexto, de repente pues como ser humano queremos decir, “Ah, yo soy una persona así, así, así, quisiera saber tal cosa, vivo por tal lugar.” Esas cosas traten de ser lo más ambiguas que puedan y con eso ya van a estar protegiéndose fácilmente de no de no estar luego con filtraciones de de su información.

Mejoras de seguridad a nivel organizacional

Jacquie: Y bueno, a nivel organización aplican las mismas tres prácticas a nivel personal, pero podemos hacer otras cositas como capacitar y concientizar al personal. Esto se hablará también, creo que en un tercer webinar por ahí seguro nadie me complementará, pero justo esto todo lo piden las normativas, ¿no? O sea, una normativa ISO, una normativa PCI, hasta las propias regulaciones y leyes, pues siempre van a estar más enfocadas en que la persona sepa.

Recordemos que el eslabón débil de cualquier empresa es el colaborador, es el ser humano. Entonces, capacitar y concientizar a tu personal en el uso responsable y de ahí se va el segundo punto, justamente documentar estas políticas, estos procedimientos que bajen estos lineamientos y directrices de cómo es el uso responsable para su empresa al usar estas herramientas. difúndanlas y tengan todo eso bajo bajo control y documentado, todo documentado. Siempre no hay excusa de que de que no está ahí, lo pueden consultar en todo momento.

Sistema de gestión de inteligencia artificial – ISO 42000

Jaquie: Y por último, si tu empresa ofrece servicios de guía o estás pensando en hacer algo sobre eso, en ofrecer algún servicio, en hacer algo con la dentro de tus propios productos, servicios, etcétera, hay que tener muy bien unos procesos para los datos. Esto también se va a hablar quizás un poquito más a detalle en la en el tercer webinar donde hablamos vamos a hablar de la ISO 42000, pero justamente esa normativa nos habla de la importancia de la calidad de los datos. va derivado un poco de todo lo que hablábamos, ¿no?

El que los datos de entrenamiento hayan sido validados, verificados, que puedas demostrar de dónde vienen, o sea, cuál es su procedencia, ¿no? No solo porque lo puse en Google, sino que va a ser muy importante tener esa trazabilidad desde todo el ciclo de vida de los datos que vayas a usar para entrenar tus modelos o tus sistemas. va a ser muy importante tener eso documentado y bien establecido en algún procesito de dentro de la organización.

Natalia: Aprovecho y hago este comentario que a mí me pasa en mi rol, que soy del equipo de marketing y le puede pasar de tanto muchos roles, que tanto hablar con la inteligencia artificial uno como que se olvidó. Entonces, hace poco yo le pregunté, “Bueno, ¿qué tanto sabes de mí? y sabía bastante. Entonces, yo creo que y los invito también a todos aquí cuando salgan de aquí, pregunten al chat GPT qué tanta información tienen de ustedes.

Y ahí se van a dar cuenta que a veces de forma inconsciente estamos dando todos estos datos y estamos dando toda esta información que mencionaba Jacqui, por otro lado, también aprovecho y hago un comentario de Adolfo y cuenta que él está estoy preparando una charla para abogados y hubo casos de abogados que presentaron escritos con referencia a casos que se inventó.

Jacquie: Sí, imagina eso. Por eso hay que revisar muy bien.

Natalia: Y pasa, ¿no? Y a veces uno como que quiere tener la razón y dice, “Espera, le pregunto a la inteligencia artificial a ver qué dice.” Y lo toma como Dios y voto, ¿no? Entonces no es así.

Cierre y próximos pasos

Natalia: Bueno, y ya llegando al final de este espacio, nuevamente les agradezco a todos por estar aquí y los invito a nuestro próximo webinar. Nuestro próximo webinar también va a estar Nico y va a estar el líder del equipo de hackers. El equipo de Ethical hacking, creo que pronto me lo comimos al inicio, pero en Hackmetrix también hacemos ethical hacking con pentest certificados.

Entonces, el líder de ellos va a estar acá, va a estar contándoles sobre vulnerabilidades, explicándoles e igual con Nico. Entonces, como les cuento, tráiganse al CTO, devuélvete un momentico, Jacqui, a la anterior diapositiva, porfa. Y así como ven aquí en este meme, sí, todos somos affairs, todo el mundo es optimicemos, sí, ya todas las empresas están corriendo, también tenemos que correr nosotros y llega el prompt injection y todo se derrota.

Entonces, los esperamos en este webinar por correo y les estaré contando qué más va a pasar. Y adicional a eso, ahora sí, a la siguiente, les voy a hacer como la última cuña de algunas cosas y es que Hackmetrix, todas estas vulnerabilidades y todos estos casos que contó Jacqui, los estamos contando semana a semana en el hacknews. Justo yo estoy escribiendo el hacknews. Ahí semana a semana les estoy contando qué pasa, los mejores hackeos, qué herramientas les pueden funcionar. Les mando retos también. Vamos a empezar con un reto como empezar a hacer pequeños hackings. Y bueno, ahí los espero.

Pueden escanear el QR o también en el en la descripción de este video, ahí está el próximo webinar, el hacknews. Y también les dejé como un bonus el test de phishing que lo pueden llevar a su equipo y hacerlo y estarlos concientizando sobre el tema. Listo. No sé si de pronto Nico o Jacqui tienen algo extra para decir.

Jacqui: No, de mi parte no. La verdad ahí he visto también por ahí Jairo comentaba justo una herramienta, así que también para hacer un poquito hasta de comunidad, cualquier cosa que pueda ayudar para que todos nos concienticemos en en esto del uso responsable bienvenido y pues nada, un gustazo haber estado aquí también con ustedes, tío.

Nicolás: Sí, yo también. Nada, gracias. Y es importante lo que digo siempre es que esto es nuevo, tenemos que aprender todos juntos y apoyarnos. Esa es la idea, esa es la idea de este webinar también. Exacto. Entonces, este es nuestro primer webinar.

Natalia: Pueden tener esto va a quedar aquí grabado. Pueden compartir este link a todos sus colaboradores para que tengan toda esta información. Nuevamente muchas gracias por asistir, por estar aquí con nosotros y nos vemos el próximo miércoles en el siguiente webinar. Espero que tengan buena tarde en algunos lugares ya buena noche, que estén muy bien.

Escrito por: Gisel Cisternas

Pasante de marketing